Sabe aqueles robôs de filme que entendem o que você fala, olham ao redor, planejam o que fazer e executam tarefas complexas com perfeição? Por muito tempo, isso pareceu coisa de ficção científica.

Os robôs do mundo real são, na maioria das vezes, braços mecânicos em uma fábrica, programados para fazer um único movimento, repetidamente, por anos a fio. São ótimos nisso, mas péssimos em qualquer outra coisa.

Agora, o Google DeepMind acaba de anunciar algo que pode ser o passo que faltava para tirar os robôs inteligentes das telas de cinema e trazê-los para o nosso mundo.

Apresentado como Gemini Robotics 1.5, este não é apenas mais um software, mas uma nova forma de dar um “cérebro” aos robôs.

A grande sacada do Google foi perceber que, assim como nós, os robôs podem ser mais eficientes se tiverem uma parte da mente para pensar e planejar, e outra para agir e executar.

Essa divisão simples, mas genial, promete destravar um potencial que até agora estava adormecido, permitindo que as máquinas se tornem mais versáteis, adaptáveis e, finalmente, mais úteis no nosso dia a dia.

Vamos entender como essa tecnologia funciona e por que ela é tão revolucionária.

A revolução dos dois cérebros

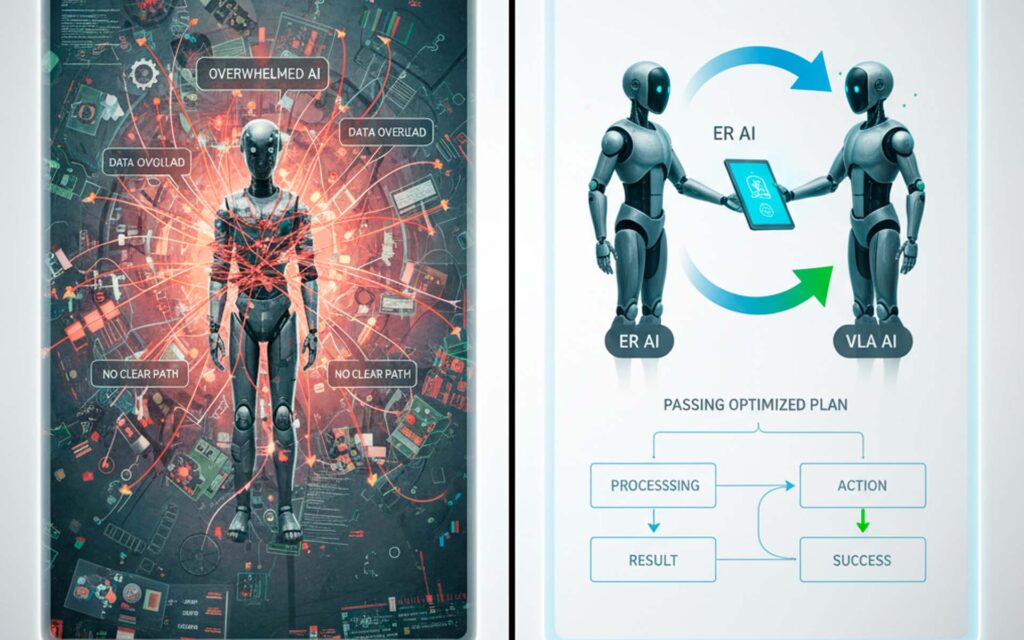

Até agora, um dos maiores desafios da robótica com inteligência artificial era que um único modelo de IA tentava fazer tudo ao mesmo tempo.

Ele precisava entender um comando em linguagem natural (como “jogue o lixo fora”), analisar o ambiente com suas câmeras, criar um plano de ação e controlar os motores para executar o movimento. Isso gerava um processo lento, cheio de erros e pouco eficiente.

Era como tentar ler um mapa, planejar o caminho e dirigir um carro ao mesmo tempo – as chances de algo dar errado são grandes.

A solução do Google DeepMind foi dividir o trabalho em dois modelos de IA especializados que trabalham em conjunto, como uma dupla afinada.

- O Pensador (O Estrategista): Chamado de Gemini Robotics-ER 1.5. A sigla “ER” significa “Embodied Reasoning” ou “Raciocínio Incorporado”. Este é o cérebro que planeja.

- O Executor (O Atuador): Chamado simplesmente de Gemini Robotics 1.5. Este é o cérebro que transforma os planos em ações físicas.

Essa abordagem de “dividir para conquistar” permite que cada parte do “cérebro” do robô se concentre no que faz de melhor, resultando em um desempenho muito superior, mais rápido e mais inteligente.

Gemini Robotics-ER 1.5: O Estrategista

Pense no modelo ER 1.5 como o grande estrategista. Ele é um VLM, ou “Modelo de Visão e Linguagem”.

De forma simples, isso significa que ele consegue “ver” o mundo através das câmeras do robô e, ao mesmo tempo, “entender” o que uma pessoa pede em linguagem normal.

Quando você dá uma tarefa complexa, como “separe esses itens nas lixeiras de lixo, reciclagem e orgânico”, o ER 1.5 entra em ação. Primeiro, ele analisa os objetos.

Se ele não souber as regras de reciclagem da sua cidade, ele pode usar ferramentas, como o Google Search, para pesquisar na internet e descobrir o que vai em cada lixeira. Com base nessa informação, ele cria um plano detalhado, passo a passo, em linguagem natural.

O plano seria algo como: “1. Pegue a garrafa de plástico. 2. Coloque na lixeira de reciclagem. 3. Pegue a casca de banana. 4. Coloque na lixeira de orgânicos.”

Ele não move um único parafuso do robô. Sua única função é pensar, raciocinar sobre o ambiente físico e criar a melhor estratégia para completar a missão.

Gemini Robotics 1.5: O Executor

Uma vez que o plano está pronto, ele é enviado para o segundo cérebro, o Gemini Robotics 1.5. Este modelo é um VLA, ou “Modelo de Visão, Linguagem e Ação”.

Ele recebe as instruções do estrategista (a linguagem), continua usando as câmeras para se guiar (a visão) e traduz tudo isso em comandos precisos para os motores do robô (a ação).

Mas ele não é apenas um executor “burro”. Antes de realizar cada passo, ele também faz seu próprio microplanejamento.

Por exemplo, ao receber a instrução “pegue a garrafa de plástico”, ele analisa a forma da garrafa, calcula o melhor ângulo para agarrá-la sem derrubar e define a trajetória mais eficiente para movê-la até a lixeira.

Uma das características mais interessantes é que ele pode explicar o que está pensando em linguagem natural, trazendo mais transparência e confiança ao processo.

Por que essa divisão é tão importante?

Separar o pensamento da ação resolve um gargalo fundamental na robótica. Modelos de IA gigantes, como os que geram texto, não foram feitos para entender as nuances do mundo físico, como a geometria de um objeto ou a melhor forma de aplicar força. Ao forçar um único modelo a fazer tudo, o resultado era um robô hesitante e desajeitado.

Com a nova arquitetura do Google DeepMind, cada modelo é otimizado para sua função. O “Pensador” é excelente em lógica, planejamento e acesso a informações.

O “Executor” é um mestre em controle motor fino e navegação no espaço 3D. Essa especialização torna o sistema todo muito mais robusto.

Isso permite que os robôs realizem tarefas de múltiplos passos de forma fluida e contínua. O que antes exigiria uma programação manual complexa e demorada para cada pequeno detalhe, agora pode ser solicitado com uma simples frase.

De Robôs Específicos para Robôs Universais

Talvez a consequência mais empolgante dessa tecnologia seja a possibilidade de criar robôs de propósito geral.

Hoje, um robô que aperta parafusos em uma linha de montagem não pode ser usado para empacotar caixas sem meses de reprogramação. Eles são altamente especializados.

O Gemini Robotics 1.5 foi projetado para ser adaptável. Os pesquisadores do Google DeepMind testaram o sistema em diferentes tipos de robôs, como o humanoide Apollo e o de dois braços Aloha 2.

Eles descobriram algo incrível: as habilidades aprendidas em um robô podem ser transferidas para outro. Por exemplo, a IA aprende a manusear objetos com as garras do Aloha 2 e consegue aplicar esse conhecimento para usar as mãos mais complexas e parecidas com as humanas do Apollo, sem precisar de um treinamento específico para isso.

Isso significa que, no futuro, poderemos ter um único “cérebro” de IA que pode ser instalado em robôs de diferentes formatos e tamanhos, seja para ajudar em casa, em um hospital ou em um armazém. O robô se tornaria uma plataforma, e a inteligência, um sistema operacional universal.

O que isso significa para o futuro (e para nós)?

É importante manter os pés no chão. Ainda estamos longe de ter um robô como a Rosie, dos Jetsons, em casa, cuidando de todas as tarefas domésticas.

A tecnologia ainda está em fase de desenvolvimento e testes. No entanto, o Google DeepMind já deu um passo importante para acelerar esse futuro.

A empresa disponibilizou o modelo “Pensador” (Gemini Robotics-ER 1.5) para desenvolvedores e pesquisadores através de sua plataforma Google AI Studio.

Isso significa que, a partir de agora, qualquer pessoa com conhecimento em robótica pode começar a usar essa IA para criar planos e instruções para seus próprios robôs.

O modelo “Executor”, por ser mais complexo e diretamente ligado ao hardware, ainda está restrito a parceiros selecionados.

Essa abertura deve criar uma onda de inovação na comunidade de robótica. Veremos robôs se tornando mais inteligentes em laboratórios de universidades e empresas de tecnologia ao redor do mundo.

A longo prazo, as aplicações são quase ilimitadas: robôs assistentes para idosos, máquinas mais eficientes para logística, autômatos para realizar trabalhos perigosos em locais de desastre e muito mais.

O Gemini Robotics 1.5 não é apenas uma atualização; é uma mudança de paradigma. Ao ensinar os robôs a “pensar antes de agir”, o Google DeepMind não está apenas construindo máquinas melhores, mas também nos aproximando de um futuro onde a colaboração entre humanos e robôs inteligentes será uma parte comum e natural de nossas vidas.